【AI倫理】AI導入プロジェクトはなぜ「仕様通り」でも炎上するのか? PM・PMOに求められる新しいリスクマネジメントの"型"

AI、特に生成AIの導入が、あらゆる業界で急速に進む

経営層からは「AIを活用して業務効率を上げろ」「新しい価値を創出しろ」という号令がかかり、現場のプロジェクトマネージャー(PM)やPMOの皆さんは、その推進役として期待されていることでしょう。

しかし、その一方で、こんな「見えない不安」を感じていませんか?

「AIが生成したコンテンツの著作権は大丈夫だろうか?」

「学習データにバイアスが潜んでいて、差別的な結果を招かないか?」

「便利だからと従業員が機密情報を入力してしまわないか?」

これらの不安は、決して杞憂ではありません。AIプロジェクトには、従来のシステム開発とは根本的に異なるリスクが潜んでいるのです。

仕様通り=成功、ではないAIプロジェクトの本質

従来のシステム開発プロジェクトにおいて、私たちのミッションは明確でした。「仕様書通りに」「バグなく」「QCDを守って」システムを納品すること。極論すれば、「仕様通りに動くこと」がプロジェクト成功の大部分を占めていました。

しかし、AIプロジェクト、特に機械学習や生成AIを用いるプロジェクトでは、この常識が通用しません。

「仕様通り」に動いているはずなのに、プロジェクトが大炎上する。

なぜでしょうか?

それは、AIが「データ」に依存し、「確率的」に振る舞うからです。従来の開発ではPMが「ロジック(仕様)」をほぼ100%コントロールできましたが、AI開発ではそうはいきません。AIは与えられたデータから「ロジックのようなもの」を自ら学習します。その結果、「仕様書に書かれていないこと」――例えば、学習データ自体が内包していた社会的な偏見(バイアス)や、AIの予測不能なアウトプット――が、プロジェクトの成否を揺るがす最大のリスク源となるのです。

PM/PMOの責任範囲は「仕様書の"外"」へ拡張された

このAIプロジェクト特有のリスク本質は、私たちPM/PMOの責任範囲が「拡張」されたことを意味します。

従来の責任が、主に「仕様書の中」で定義されたQCDや品質(バグ)の管理だったとすれば、AIプロジェクトにおける新しい責任は、「仕様書の"外"」にまで広がっています。

- データの「質」と「偏り」の管理: どんなデータでAIを育てるのか?

- AIの「振る舞い」の管理: AIのアウトプットは倫理的か? 公平か?

- AIの「使われ方」の管理: 従業員や顧客はAIを安全に利用できているか?

これらは、もはや単なる「技術的な品質」の問題ではなく、「ビジネスリスク」「法的リスク」「レピュテーションリスク」に直結する、経営レベルの課題です。そして、その最前線に立つPM/PMOが、これらのリスクを管理する役割を担わなければ、AIプロジェクトの成功はおろか、企業の存続すら危うくなる可能性があるのです。

求められるのは「管理の型」と「武器」

では、この新しく、かつ重大な責任を、私たちはどう果たせばよいのでしょうか?

「AI倫理」の重要性が叫ばれて久しいですが、その多くは抽象的な理念や原則論に留まりがちです。「具体的に、プロジェクトで何をすればいいのか?」という現場の問いに、明確な答えを与えてくれるものは多くありませんでした。

必要なのは、AI倫理という曖昧な概念を、PM/PMOの実務に落とし込める「リスクマネジメントの型」であり、それを実行するための具体的な「武器(ツール)」です。

私が今回Udemyでリリースした講座『PM・PMOとして装着しておくべき「AI倫理」実践講座|プロジェクト炎上を防ぐリスクマネジメント術』は、まさにその「型」と「武器」を提供するために開発しました。

この講座では、

- AI特有の「6大リスク」(バイアス、プライバシー、著作権、XAI、セキュリティ、情報漏洩)を体系的に解説。

- PMBOKのリスク管理プロセス(特定→評価→対処)を応用し、これらのリスクを管理する具体的な「型」を提示。

- 現場ですぐに使えるExcel雛形「AIリスク特定チェックリスト」と「AI利用ガイドライン」を提供。

- ウォーターフォール型、アジャイル型、それぞれの開発プロセスへの実践的な「組み込み方」を解説。

…といった、AIプロジェクトを管理する上で「明日から使える」実践的な内容に特化しています。

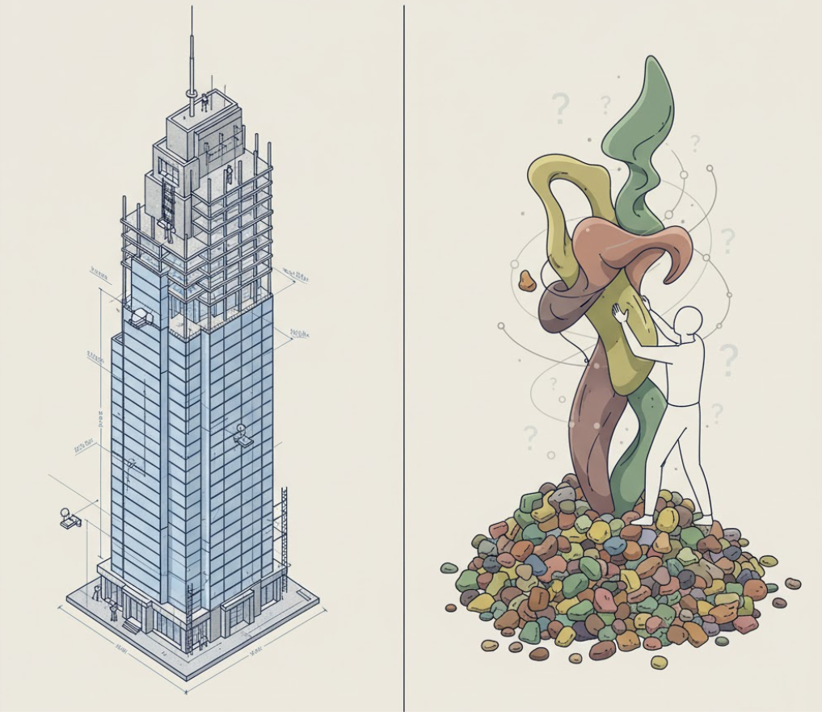

(例) AI導入プロジェクト6大リスクについて

AI時代を生き抜くPM/PMOへ

AIは、私たちの仕事や社会を劇的に変える可能性を秘めた強力なツールです。しかし、その力を正しく制御できなければ、諸刃の剣となりかねません。

AIプロジェクトの成否は、もはや技術力だけでは決まりません。AIリスクを適切に管理し、社会からの信頼を得ながらAI活用を推進できるかどうかにかかっています。そして、その鍵を握るのが、私たちPM/PMOなのです。

このブログ記事が、AI時代の新しいリスクに立ち向かうための一助となれば幸いです。そして、もし「具体的な管理の型を習得したい」「すぐに使える武器が欲しい」と感じていただけた場合は、Udemyの講座でお会いしましょう!

【Udemy講座】

【プロマネ×AI倫理】PM・PMOとして装着しておくべき「AI倫理」実践講座|プロジェクト炎上を防ぐリスクマネジメント術

PM・PMO必携!生成AIリスク(バイアス・著作権・情報漏洩)管理の実践コース。プロジェクトマネジメント現場で役立つチェックリスト&ガイドライン(全社向け&AI開発者向け)雛形ダウンロード特典付

※タイトル、サムネイルクリックでUdemyの講座ページへ遷移します。